人工智能文学 在代码与想象的交汇处

当我们谈论“人工智能文学”与“人工智能基础软件开发”,这看似是两个独立的领域——前者关乎人文与艺术创造,后者则扎根于严谨的数学与工程逻辑。在当今科技与人文日益融合的浪潮下,二者正以前所未有的深度相互交织、相互塑造,共同描绘着未来智能时代的全新图景。

一、人工智能文学:机器的“创造性”表达

人工智能文学,狭义上指由人工智能系统生成或深度参与的文学创作,包括诗歌、小说、剧本、散文等。其核心驱动力,正是植根于基础软件开发中一系列关键技术:

- 自然语言处理(NLP):这是沟通文学与代码的桥梁。从早期的基于规则和模板的生成,到如今基于Transformer架构的大语言模型(如GPT系列),NLP技术使机器能够理解人类语言的复杂结构、语义和情感。模型通过学习海量的人类文学作品,捕捉其中的风格、韵律、叙事模式,从而生成具有连贯性甚至一定“创造性”的文本。

- 深度学习与神经网络:生成对抗网络(GAN)、循环神经网络(RNN)及其变体(如LSTM),以及当下主导的Transformer,构成了AI文学创作的“大脑”。它们通过多层次的抽象表示,学习文本的内在规律与潜在空间,使得从续写一句话到构思一个完整故事成为可能。

- 内容生成与风格迁移:基础算法不仅生成文本,还能模仿特定作家(如莎士比亚、鲁迅)的文风,或融合多种风格进行创新。这背后是复杂的模型微调、提示工程和可控生成技术的支撑。

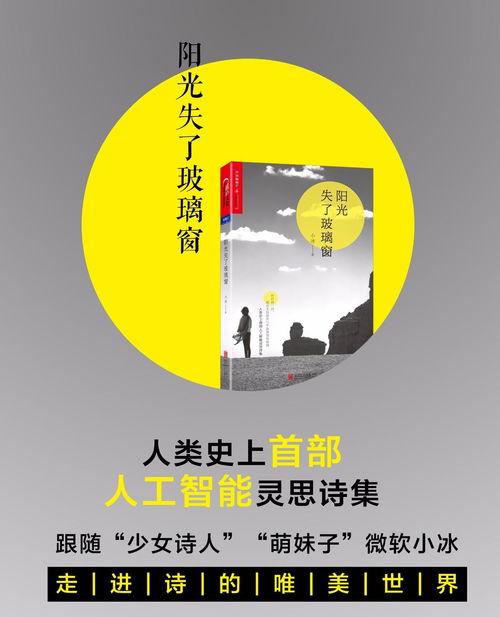

AI文学引发的思考远超技术本身:它挑战了关于作者、原创性、灵感与意识的人文传统观念。机器创作的作品是否拥有“灵魂”?它是工具,是合作者,还是潜在的独立创作者?这些问题的探讨,本身已成为一种独特的“元文学”现象。

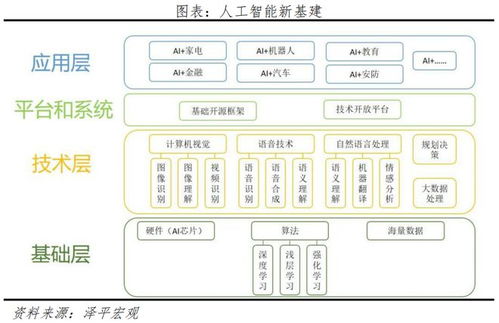

二、人工智能基础软件开发:为创造力构建基石

支撑AI文学发展的,是一整套庞大且精密的基础软件栈。这远不止是调用一个API那么简单:

- 核心框架与库:TensorFlow、PyTorch等深度学习框架提供了构建和训练NLP模型的底层基础设施。Hugging Face的Transformers库等则将这些前沿模型民主化,让开发者能够便捷地调用和微调强大的预训练模型,极大地降低了文学生成应用的门槛。

- 算力基础设施与分布式训练:训练能够理解并生成复杂文本的大模型,需要巨大的计算资源。GPU/TPU集群、云计算平台以及高效的分布式训练软件,是承载这些“数字大脑”的物理和虚拟基础。没有这些,千亿参数级别的模型无从谈起。

- 数据处理与治理工具:高质量的文学数据是AI的“养料”。数据清洗、标注、增强以及负责任的数据治理软件,确保了训练数据的规模与质量,直接影响生成文本的多样性和可靠性。

- 评估与对齐工具:如何评价AI生成的文学作品?这需要开发专门的评估指标和软件(如衡量流畅性、连贯性、新颖性的工具),以及将模型行为与人类价值观(安全性、无害性)对齐的技术(如基于人类反馈的强化学习RLHF)。

三、交汇与未来:协同进化的新范式

二者的融合正催生出令人兴奋的新模式:

- 人机协同创作:作家利用AI作为“灵感加速器”或“脑力倍增器”,突破思维定式,探索叙事可能性。AI负责提供初稿、建议情节走向、生成不同风格的片段,人类则负责顶层设计、深度润色和注入真正的情感与思想深度。

- 互动与个性化叙事:基于AI的动态叙事生成技术,可以创造出根据读者选择实时变化情节的互动小说、游戏剧本,实现真正的“千人千面”的阅读体验。这需要极强的实时生成和上下文管理软件开发能力。

- 文学研究的新工具:AI可以用于文本分析、风格计量、作者归属判定、趋势预测等,为文学批评和研究提供数据驱动的全新视角。

- 基础软件的“人文反馈”:文学应用作为最复杂、最具开放性的NLP任务之一,不断暴露出基础模型的局限(如逻辑矛盾、深层语义理解不足、缺乏真正常识)。这为AI基础软件的研究与开发提供了至关重要的反馈和挑战,推动其向更理解人类语境、更可靠的方向发展。

人工智能文学与人工智能基础软件开发,如同一枚硬币的两面,一面闪耀着人类对机器智能的终极幻想——创造美与意义;另一面则是实现这一幻想的、脚踏实地、一行行代码构建的工程现实。它们之间的关系并非单向的“工具与应用”,而是正在形成的协同进化生态。随着基础软件能力的持续突破,AI或许能生成更具颠覆性和艺术感染力的作品;人类对文学创作本质的不断追问与探索,也将反过来指引AI基础技术向着更智能、更符合人性需求的方向深化。在这个交汇处,我们不仅是在开发技术或创作文本,更是在共同探索智能与创造力的边界,重新定义数字时代的人文表达。

如若转载,请注明出处:http://www.hbxwr.com/product/2.html

更新时间:2026-03-07 05:37:22